この記事でわかること

- AIインフルエンサー特有の炎上リスク(透明性不足、不気味の谷、著作権、品質問題など)

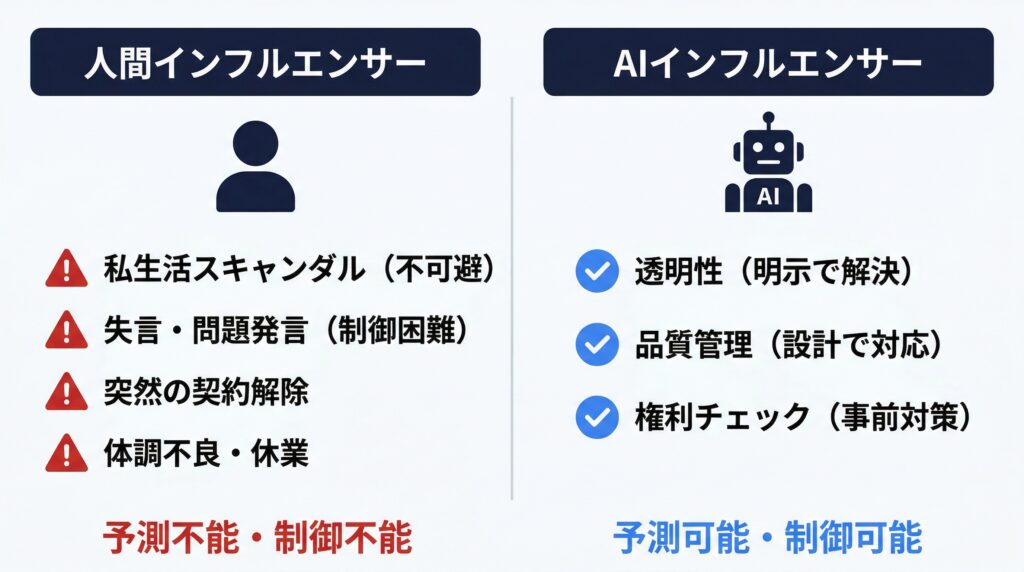

- 人間インフルエンサーとのリスク比較(スキャンダル、私生活トラブルなどとの違い)

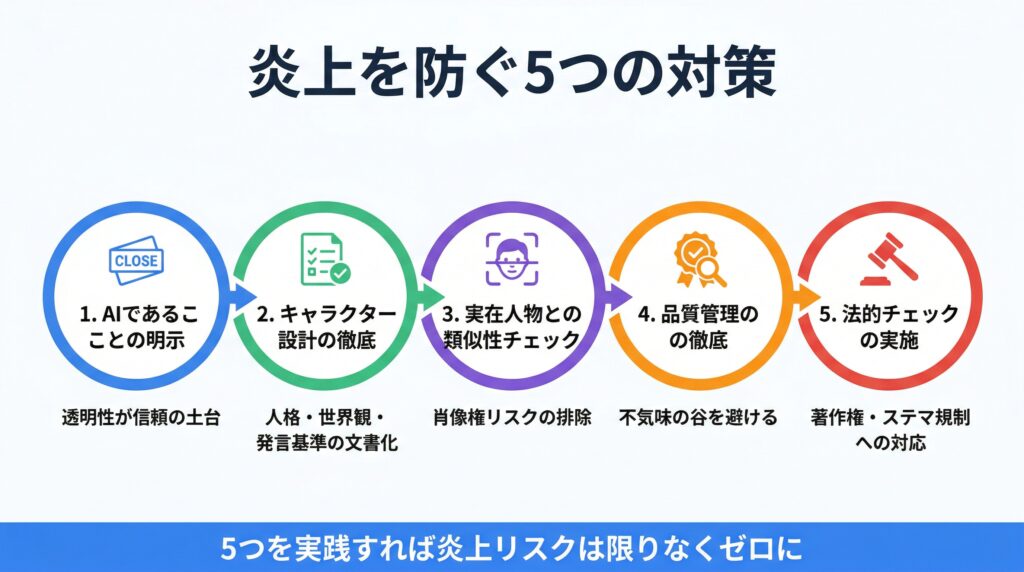

- 炎上を防ぐための具体的な対策と透明性の重要性

「AIインフルエンサーなら炎上リスクがゼロだと聞いたけど、本当?」

「AIを起用したら、かえって消費者から批判されないか?」

「透明性の問題や著作権リスクが心配」

AIインフルエンサーの導入を検討する担当者なら、こうした不安を抱くのは当然のことです。実際、AIインフルエンサーは人間タレントにはない「構造的なリスクの排除」が可能な一方で、AI特有の炎上リスクも存在します。

本記事は、AIインフルエンサー領域の国内外事例を専門に調査・発信するThe AI Influencer編集部が、最新の事例とデータをもとに解説します。WFA(世界広告主連盟)の調査で58%の企業が「スキャンダルリスクの排除」をAIインフルエンサーの最大メリットとして挙げる一方で、実際にどのようなリスクが残るのか、どう対策すればいいのかを整理します。

人間インフルエンサーとのリスク比較を交えながら、企業担当者が知るべき炎上リスクの全体像と対策を解説します。

結論から言うと──AIインフルエンサーは「炎上リスクゼロ」ではないが「管理可能」

人間タレントとAIインフルエンサー、どちらがリスクが高いか

この問いへの答えは一筋縄ではいきません。なぜなら、人間とAIでは「炎上の種類」が根本的に異なるからです。

人間インフルエンサーの炎上の主な原因は、私生活での不祥事・SNS上の失言・スキャンダル・契約違反といった「コントロール不能なリスク」です。これらは企業側が予防することは不可能で、起きてから対応するしかありません。

一方、AIインフルエンサーの炎上リスクは「設計段階で防げるリスク」がほとんどです。透明性の欠如、不気味の谷現象、著作権侵害、品質の不安定さ──これらは適切な設計と運用で事前に回避できます。

つまり、「どちらがリスクが低いか」ではなく「どちらのリスクを管理しやすいか」という視点で考えるべきです。その意味では、AIインフルエンサーの方が企業にとってコントロール可能なリスク設計が可能です。

58%の企業が「スキャンダルリスク排除」を評価する理由

WFA(世界広告主連盟)の2025年調査では、AIインフルエンサーを導入した企業の58%が「スキャンダルリスクの排除」を最大のメリットとして挙げています。これは数字として非常に大きい意味を持ちます。

人間タレントを起用したキャンペーンで、起用タレントの不祥事が発覚した場合の損害は甚大です。広告費の損失だけでなく、ブランドイメージの毀損、メディア対応コスト、次の起用タレントの選定コストまで含めると、炎上1件の総ダメージは数千万円規模になることも珍しくありません。

AIインフルエンサーにはプライベートがありません。深夜の問題行動も、私的な発言も、人間関係のトラブルも、構造的に発生しません。この「人間だからこそ起こるリスクの排除」こそが、企業がAIインフルエンサーを選ぶ最大の理由の一つです。

つまり、AIインフルエンサーは「炎上リスクゼロ」ではなく「人間特有のリスクを排除した上で、AI特有のリスクを管理できる」ということ。

AIインフルエンサー特有の4つの炎上リスク

リスク①:透明性不足による「欺いた」という批判

AIインフルエンサーで最も深刻な炎上リスクは、透明性の欠如です。「AIだと隠していた」「人間だと思わせておいて実はAIだった」と発覚した場合、消費者は「騙された」と感じ、強い反発を招きます。

実際、ベトナムでAI生成の歌手やモデルを「実在の人間」として紹介していたアカウントが発覚した際、多くのフォロワーが「AIだと知っていたら応援しなかった」「感情を操作された」と感情的な批判を寄せました。中には「AIを好きになってしまった自分はどうすればいいのか」と戸惑うファンもおり、感情操作への批判が殺到しました。

Billion Dollar Boyの調査では、76%の消費者がAIインフルエンサーの商品推薦を信頼すると回答していますが、これは「AIであることが明示されている」ことが前提です。逆に言えば、AIであることを隠せば信頼は一瞬で崩れます。

対策はシンプルです。プロフィールや投稿で「AIインフルエンサーであること」を明示する。これだけで、このリスクはほぼ完全に排除できます。

リスク②:不気味の谷現象による心理的違和感

「不気味の谷(Uncanny Valley)」とは、ロボット工学者の森政弘氏が1970年に提唱した概念で、人間に似たロボットやキャラクターが一定以上人間に近づくと、かえって強い嫌悪感を引き起こす現象を指します。

AIインフルエンサーにもこの現象が当てはまります。ビジュアルが「人間に近いが完璧ではない」場合、虚ろな目、不自然な表情、ぎこちない動きといった微妙な違和感が、見る人に本能的な不快感を与えることがあります。

対策としては、「あえてリアルすぎないデザインにする」か「徹底的に品質管理をして不自然さを排除する」のどちらかです。中途半端なリアルさが最もリスクが高いため、最初からキャラクターの方向性を明確に決めることが重要です。

リスク③:著作権・肖像権の侵害リスク

AIインフルエンサーのビジュアルを画像生成AIで作成する場合、著作権と肖像権のリスクがあります。

まず、AIが生成した画像の著作権は法的にグレーゾーンです。日本の著作権法では著作物は「人間の創作活動」から生まれたものと定義されており、AIが完全に自動生成した画像には原則として著作権が認められません。

さらに深刻なのが肖像権のリスクです。AIが生成した顔が特定の実在人物に似てしまった場合、肖像権やパブリシティ権の侵害が問われる可能性があります。あるゲーム会社が人気アイドルの顔をAIで無断使用し、数千万円の賠償金を支払った事例も報告されています。

対策としては、制作段階から「実在の人物に似せない」ことを設計ルールに組み込み、完成後に類似性チェックを行うことが必須です。

リスク④:品質の不安定さによるブランドイメージ毀損

AIインフルエンサーのビジュアル品質が安定しないことも、ブランドイメージを損なうリスクになります。

画像生成AIで同一キャラクターを安定的に生成し続けるには、専門的な技術と継続的なチューニングが必要です。投稿ごとに顔が微妙に違ったり、キャラクターの一貫性が保てなかったりすると、「制作が雑」という印象を与え、ブランドの信頼性を損ないます。

中国のバーチャルアイドル「翎Ling」は、リップクリームのレビュー投稿で「潤いがあって乾かない」と発言し、炎上しました。「デジタルキャラクターが化粧品の使用感を語るのは不誠実」という批判が殺到したのです。物理的な商品のレビューにおいては、AIインフルエンサーが「体験」を語ることへの違和感が消費者の反発を招く好例です。

つまり、AIインフルエンサーの炎上リスクは「透明性」「不気味の谷」「権利侵害」「品質」の4つに集約され、いずれも設計段階で対策可能ということ。

人間インフルエンサーの炎上リスク──比較で見える決定的な違い

人間特有のリスク:私生活スキャンダル・失言・突然の契約解除

人間インフルエンサーを起用する企業が最も恐れるのは、コントロール不能な私生活での出来事です。

過去には、起用タレントの不祥事が発覚した翌日に広告を全面取り下げ、謝罪対応に追われた企業が数多く存在します。熱愛報道、不倫スキャンダル、SNSでの問題発言、脱税、薬物問題──これらはすべて企業側が予防することは不可能で、起きてから対応するしかありません。

さらに「突然の契約解除」も人間ならではのリスクです。体調不良、心理的な理由、他社への移籍など、人間側の事情で契約が継続できなくなるケースは珍しくありません。

AIにはないリスク:「中の人」の存在

VTuberやバーチャルインフルエンサーの場合、「中の人」と呼ばれる実在の演者が存在するケースが多いです。この場合、人間インフルエンサーと同様のリスクが発生します。

中の人が引退すればキャラクターも消えます。中の人がスキャンダルを起こせばキャラクターも巻き込まれます。Hololiveの配信者が政治的な発言を行い、中国市場から撤退を余儀なくされた事例は記憶に新しいでしょう。

AIインフルエンサー(特に完全自律型)には「中の人」が存在しないため、このリスクを構造的に排除できます。

リスクの比較まとめ

| リスクの種類 | 人間インフルエンサー | AIインフルエンサー |

|---|---|---|

| 私生活スキャンダル | あり(不可避) | なし |

| 失言・問題発言 | あり(制御困難) | 設計で防止可能 |

| 突然の契約解除 | あり | なし |

| 透明性の問題 | なし(実在するため) | あり(明示が必要) |

| 品質の不安定さ | あり(体調・気分) | あり(技術次第) |

| 権利侵害リスク | なし | あり(要チェック) |

| コスト予測 | 困難(都度変動) | 可能(固定費中心) |

つまり、人間インフルエンサーのリスクは「予測不能・制御不能」、AIインフルエンサーのリスクは「予測可能・制御可能」という決定的な違いがあるということ。

炎上を防ぐ5つの具体的な対策

対策①:AIであることの明示──透明性が信頼の土台

最も重要で、最も簡単な対策です。プロフィール欄や投稿のハッシュタグで「AIインフルエンサーであること」を明示します。

immaやLil Miquelaなどの成功しているAIインフルエンサーは、すべて「AIであること」を公開した上で活動しています。隠す必要はありません。Billion Dollar Boyの調査で76%の消費者が「AIインフルエンサーの商品推薦を信頼する」と回答しているのは、AIであることが明示された状態での数字です。

逆に、AIであることを隠したまま活動すると、発覚した瞬間に「欺瞞」として批判され、回復困難な信頼損失を招きます。

対策②:キャラクター設計の徹底──人格・世界観・発言基準の文書化

AIインフルエンサーの成否はキャラクター設計で決まります。外見だけでなく、「このキャラクターは何者で、何を大切にして、どんな言葉を使うのか」という人格設計まで詰めることが不可欠です。

設計時に決めるべき主な項目は4軸です:

- 外見(髪型・体型・ファッションスタイル・国籍設定)

- 声(トーン・テンポ・口癖)

- 人格(価値観・好きなもの・嫌いなもの・得意分野)

- 世界観(どんな日常を送っているか・どんなブランドと親和性があるか)

これらを文書化し、投稿内容やコメント対応のガイドラインとして運用することで、キャラクターの一貫性を保ちます。

対策③:実在人物との類似性チェック──肖像権リスクの排除

画像生成AIでキャラクターを作成した後、実在の人物(特に有名人)と似ていないかをチェックします。

チェック方法としては、画像検索ツールでの類似画像検索や、複数人での目視確認が有効です。「どこかで見たような顔」にならないよう、独自性のあるビジュアル設計を心がけることが重要です。

対策④:品質管理の徹底──不気味の谷を避ける

ビジュアル品質の管理は、不気味の谷現象を避けるために不可欠です。

「リアルすぎない」方向で設計するなら、あえてアニメ調やイラスト調にする選択肢があります。「リアル」方向で設計するなら、目の輝き、肌の質感、表情の自然さなど、細部まで品質を担保する必要があります。

どちらにせよ、中途半端なリアルさが最もリスクが高いため、方向性を明確にして一貫させることが重要です。

対策⑤:法的チェックの実施──著作権・ステマ規制への対応

最後に、法的側面のチェックを行います。

著作権については、制作会社との契約時に「著作権の帰属先」を明確にします。ステマ規制(景品表示法)については、企業から依頼を受けたPR投稿で「#PR」「広告」などの表記を行います。AIインフルエンサーであってもステマ規制の対象外ではありません。

つまり、透明性の確保・キャラクター設計・権利チェック・品質管理・法務対応の5つを実践すれば、AIインフルエンサーの炎上リスクは限りなくゼロに近づけるということ。

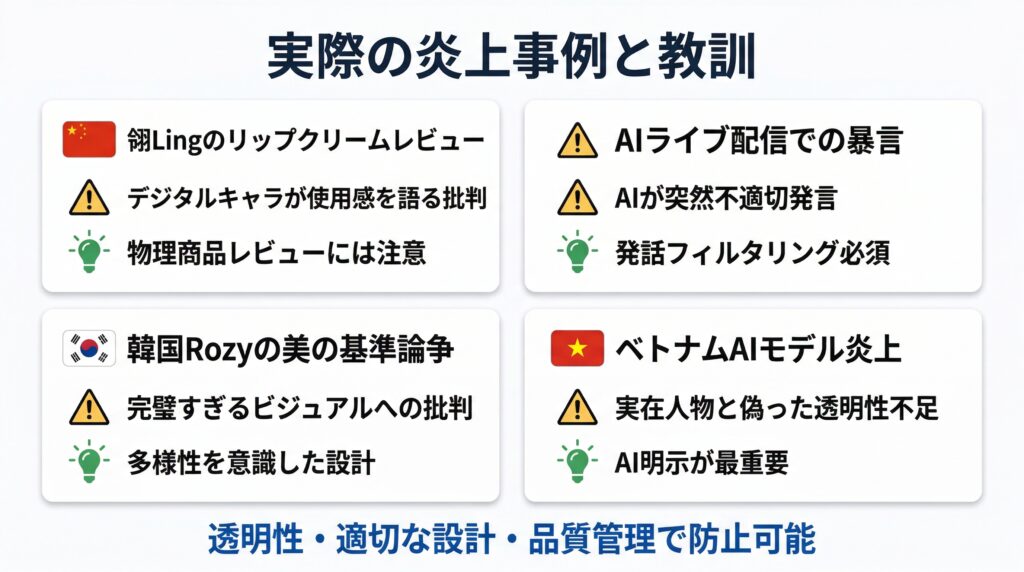

実際の炎上事例と教訓

事例①:翎Lingのリップクリームレビュー炎上

中国のバーチャルアイドル「翎Ling」は、リップクリームの商品レビューで「潤いがあって乾かない」と発言し、炎上しました。「デジタルキャラクターが物理的な化粧品の使用感を語るのは不誠実」という批判が殺到したのです。

教訓:物理的な体験を伴う商品のレビューには注意が必要です。AIインフルエンサーに「使用感」を語らせるのではなく、「ビジュアルの魅力」や「ブランドの世界観」を訴求するコンテンツに留めるべきです。

事例②:AIライブ配信での暴言事故

AIバーチャルアイドルがライブ配信中に突然暴言を吐き、緊急で配信が停止される事故が発生しました。AIの発話生成機能が意図せず不適切な言葉を生成してしまった事例です。

教訓:リアルタイムでのAI発話にはリスクがあります。ライブ配信を行う場合は、発話内容のフィルタリング機能や、緊急停止の仕組みを用意しておく必要があります。

事例③:韓国Rozyの「美の基準」論争

韓国初のバーチャルインフルエンサー「Rozy」は、年間8億ウォン(約8,000万円)以上の収益を上げ、100社以上のブランドと契約する成功を収めました。しかし、「完璧すぎるビジュアルが現実離れした美の基準を広める」という批判も受けました。

教訓:AIインフルエンサーのビジュアルが「理想的すぎる」こと自体が批判の対象になることがあります。キャラクター設計において、多様性や現実味を意識することも一つの選択肢です。

事例④:ベトナムAIモデルの「実在しない人物」炎上

ベトナムで、AI生成の歌手やモデルを「実在の人間」として紹介していた複数のアカウントが発覚し、炎上しました。「AIだと知っていたら応援しなかった」「感情を操作された」という批判が殺到し、多くのファンが戸惑いを見せました。

教訓:透明性の欠如は最も深刻な炎上を招きます。「AIであること」を最初から明示することで、このリスクは完全に防げます。

つまり、炎上事例から学べるのは「透明性」「適切なコンテンツ設計」「品質管理」の3つができていれば、ほとんどの炎上は防げるということ。

よくある質問【Q&A】

Q:AIインフルエンサーの方が炎上リスクが低いと考えていい?

A:「リスクの種類が違う」というのが正確な理解です。人間インフルエンサーは「予測不能な私生活の問題」が起こり得ますが、AIインフルエンサーにはそれがありません。一方、AIには「透明性」「品質」「権利」というAI特有のリスクがあります。ただし、AI特有のリスクは設計段階で対策可能です。管理しやすさで言えばAIに分があります。

Q:「AIであること」を明示すると、フォロワーが減らない?

A:データはその懸念を否定しています。Twimbit(2025年)の調査では、AIインフルエンサーの反応率は人間インフルエンサーの平均3倍。これはAIであることが広く知られているキャラクターが出している数字です。「AIだと知った上で応援される」設計こそが重要です。

Q:ステマ規制はAIインフルエンサーにも適用される?

A:はい、適用されます。2023年10月に施行された景品表示法のステルスマーケティング規制は、AIインフルエンサーも例外ではありません。企業から依頼を受けたPR投稿には「#PR」「広告」などの表記が必要です。ただし、投稿内容を完全にコントロールできるため、人間インフルエンサーより管理しやすい側面もあります。

Q:AIインフルエンサーを自社で制作する場合、法的に注意すべき点は?

A:主に3点です。①著作権の帰属(AI生成画像の権利関係を契約で明確にする)、②肖像権(実在人物に似せない設計と事後チェック)、③ステマ規制(PR投稿での広告表示)。これらを制作段階で確認すれば、法的リスクはほぼ回避できます。

Q:炎上してしまった場合、どう対応すべき?

A:まずは事実関係を確認し、速やかに謝罪や説明を行います。AIインフルエンサーの場合、投稿内容はすべて企業側がコントロールしているため、「担当者の確認不足」などの説明が可能です。人間インフルエンサーのような「本人の問題」とは異なり、企業側の責任として対処できます。

この記事のまとめ

- AIインフルエンサーの炎上リスクは「透明性不足」「不気味の谷」「著作権・肖像権」「品質の不安定さ」の4つ。いずれも設計段階で対策可能

- 人間インフルエンサーとの決定的な違いは、リスクが「予測不能・制御不能」か「予測可能・制御可能」か。AIは後者で管理しやすい

- 炎上防止の5つの対策は、AIであることの明示、キャラクター設計の徹底、実在人物との類似性チェック、品質管理、法的チェック

- 透明性が最も重要。AIであることを隠すと深刻な炎上を招くが、明示すれば76%の消費者が信頼する

- 実際の炎上事例から学べるのは、物理商品のレビューには注意が必要なこと、ライブ配信にはフィルターが必須なこと、「完璧すぎる」こと自体が批判対象になり得ること

AIインフルエンサーの制作・運用をどこに依頼すべきか迷っている場合は、制作から運用まで一気通貫で対応しているBeyondAIにご相談ください。透明性の確保から法的チェックまで、炎上リスクを最小化する運用体制を構築できます。